Durante anos, navegadores se tornaram cada vez mais pesados. Primeiro vieram os múltiplos processos, depois as dezenas de serviços em segundo plano, sincronização constante, isolamento de abas, aceleração por GPU e integrações que transformaram o navegador praticamente em um sistema operacional paralelo.

Agora, o Chrome parece ter dado mais um passo nessa direção: distribuir silenciosamente um modelo local de inteligência artificial de aproximadamente 4 GB para milhões de computadores. E muita gente sequer percebeu isso.

A descoberta ganhou atenção nesta semana depois que o pesquisador e ativista de privacidade Alexander Hanff publicou um artigo afirmando que o Chrome estaria instalando localmente o Gemini Nano, a versão compacta do modelo de IA do Google, sem consentimento explícito dos usuários.

O arquivo principal aparece como weights.bin dentro de uma pasta chamada OptGuideOnDeviceModel. Em alguns casos, usuários relataram que o navegador simplesmente baixa novamente o modelo mesmo após exclusão manual.

Embora o tom alarmista tenha dominado parte da repercussão inicial, a situação é mais complexa do que parece à primeira vista.

O Chrome já faz isso há algum tempo

Apesar da discussão ter explodido agora, há indícios de que o Chrome distribui modelos locais de IA há meses. Relatos no Reddit indicam downloads automáticos desde pelo menos 2025, inicialmente com modelos próximos de 3 GB. No fim do ano passado, usuários já relatavam versões chegando perto dos 4 GB atuais.

O componente em questão é o Gemini Nano, versão local do modelo Gemini usada pelo Chrome para alimentar recursos internos e APIs experimentais, incluindo a Prompt API. Com isso, o navegador passa a executar certos recursos de IA diretamente no dispositivo do usuário, sem depender exclusivamente de processamento em nuvem. Do ponto de vista técnico, a ideia faz sentido.

Executar inferência local reduz a latência, diminui tráfego para servidores e permite funcionalidades offline ou sem envio constante de dados para a nuvem. O problema começa quando isso acontece sem comunicação suficientemente clara, especialmente quando estamos falando de um download automático de múltiplos gigabytes.

O “nano” do Google ocupa mais espaço que muitos sistemas Linux

Existe algo quase irônico na nomenclatura escolhida pelo Google. O Gemini Nano é considerado o modelo “leve” da família Gemini. Ainda assim, ocupa cerca de 4 GB em disco, mais espaço do que muitas distribuições Linux completas precisam para funcionar.

A situação chama atenção porque quebra uma expectativa implícita que usuários sempre tiveram em relação a navegadores: instalar um browser não deveria significar baixar automaticamente modelos de IA locais, especialmente em máquinas com armazenamento limitado. E o impacto não é apenas sobre espaço em disco.

Modelos locais também consomem memória RAM, processamento e ciclos de atualização constantes. Em notebooks mais modestos, isso pode representar consumo adicional de bateria e recursos computacionais mesmo quando o usuário sequer faz uso consciente dessas funcionalidades.

Segundo o Google, o modelo pode ser removido automaticamente em dispositivos com poucos recursos. Ainda assim, a decisão de transformar o navegador em uma plataforma permanente de distribuição de modelos de IA pode ser uma forte quebra de expectativas para quem apenas busca a alternativa reconhecidamente mais compatível com os sites e extensões modernos.

A polêmica da privacidade talvez tenha sido exagerada

Parte da repercussão recente veio de uma mudança aparentemente pequena no texto das configurações do Chrome. Até pouco tempo atrás, a seção de IA local afirmava que os recursos funcionavam “sem enviar seus dados para servidores do Google”. A frase foi removida recentemente.

Isso levantou suspeitas de que o Google estaria mudando a arquitetura do sistema para capturar prompts e respostas gerados localmente. O Google nega.

Segundo a empresa, os modelos continuam processando dados localmente no dispositivo do usuário. A alteração no texto teria sido feita apenas para evitar ambiguidades jurídicas e técnicas, e existe uma nuance importante aqui.

Quando um site utiliza APIs do Chrome para interagir com o Gemini Nano local, o processamento da IA continua acontecendo no dispositivo do usuário. Porém, o próprio site ainda pode acessar entradas e saídas dessa interação.

Ou seja: o modelo é local, mas os dados podem continuar circulando normalmente dependendo do serviço que faz a chamada da API.

Isso significa que a remoção da frase não representa necessariamente um abandono do processamento local. Mas também mostra como a linha entre “IA local” e “dados compartilhados” pode ficar rapidamente nebulosa em ambientes modernos de navegador.

O navegador virou infraestrutura de IA

Talvez o aspecto mais interessante dessa história seja o que ela revela sobre o futuro dos navegadores. Por muito tempo, browsers eram apenas ferramentas de acesso à web. Hoje, estão se transformando em plataformas completas de execução.

O Chrome já incorpora:

- Sandboxing complexo;

- Aceleração gráfica;

- Execução isolada de processos;

- Sincronização em nuvem;

- Mecanismos de tradução;

- Sistemas de segurança em tempo real;

- Inferência local de IA.

Em certo sentido, navegadores modernos estão assumindo funções que antes pertenciam ao sistema operacional. E a chegada de modelos locais de IA parece ser apenas mais uma etapa dessa transformação.

O problema é que essa mudança está acontecendo rápido demais e com comunicação insuficiente para o usuário médio. Muita gente simplesmente não sabe que instalou um modelo local de IA junto com o navegador. Outros provavelmente nunca perceberão.

Como desativar o Gemini Nano no Chrome

Segundo o próprio Google, já existe uma forma oficial de desativar e remover o modelo local.

O processo pode ser feito acessando:

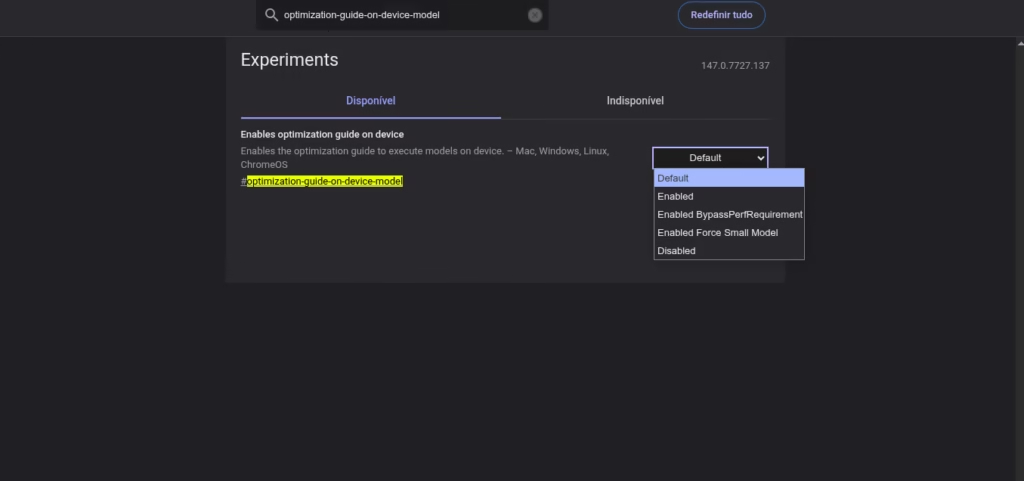

chrome://flagsDepois disso:

- procure pela opção

optimization-guide-on-device-model; - altere para

Disabled; - reinicie o navegador.

Usuários corporativos também podem aplicar políticas administrativas ou bloqueios via sistema operacional. No Windows, alguns usuários relatam sucesso criando a chave:

GenAILocalFoundationalModelSettingsno Registro do sistema dentro de:

HKEY_LOCAL_MACHINESOFTWAREPoliciesGoogleChromecom valor 1.

Não é só os 4 GB

Os 4 GB talvez sejam a parte menos importante dessa história, o debate real é sobre expectativa e transparência. Usuários aceitariam instalar conscientemente um modelo local de IA no navegador? Provavelmente muitos sim. O problema é descobrir isso depois.

Especialmente num momento em que empresas de tecnologia parecem determinadas a incorporar IA em praticamente qualquer software existente, independentemente de o usuário pedir ou não. Talvez esse seja o sinal mais claro da nova fase da indústria: a inteligência artificial deixou de ser um recurso separado; agora ela está começando a virar infraestrutura.

Ajude o Diolinux a seguir crescente e independente, seja membro Diolinux Play e tenha acesso a benefícios exclusivos!